RTX 3090 24GB

обучайте модели

до 13B параметров

от 34₽/час

Серверы с RTX 3090 24GB

Запуск за 5 минут

Оплата в рублях

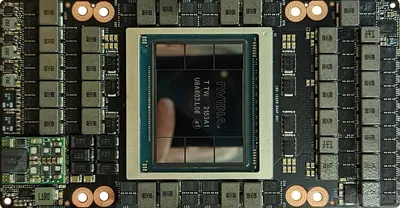

Fine-tuning и обучение моделей с нуля. 24 ГБ VRAM достаточно для полного дообучения LLaMA 7B в FP16 или QLoRA-тюнинга моделей до 13B параметров на одной карте.

RTX 3090 — самая популярная GPU для обучения в ML-сообществе: большинство туториалов и бенчмарков написаны именно под неё.

Stable Diffusion XL, FLUX, LoRA-обучение стилей. 24 ГБ памяти хватает для генерации в разрешении 1024×1024 и обучения LoRA-адаптеров на SDXL — задачи, недоступные картам с 16 ГБ.

По тестам Puget Systems, RTX 3090 — минимальная карта для полного цикла обучения SDXL без компромиссов по разрешению.

На RTX 3090 запускаются модели до 32B параметров в 4-bit квантизации — достаточно для чат-ботов, распознавания речи и пакетной обработки данных.

Ampere-архитектура с GDDR6X обеспечивает пропускную способность 936 ГБ/с, это один из лучших показателей.

Другая задача? RTX 3090 24GB — бюджетная рабочая лошадка для ML, которая справится и с ней.

24 ГБ GDDR6X и 936 ГБ/с пропускной способности — отличная карта для инференса.

Вот что помещается на одну карту.

Инференс в FP16. Самая популярная open-source LLM — ~98 tok/s на RTX 3090.

Инференс в FP16. Продвинутые рассуждения, дистиллирована из DeepSeek-R1 671B. ~100 tok/s.

Инференс в FP16. Быстрый и универсальный — ~95 tok/s на RTX 3090.

Инференс в 4-bit квантизации. Лидер среди 14B для кода — 56 tok/s на RTX 3090.

Не помещается даже в INT4 (~40 ГБ). С CPU-offload — ~2 tok/s. Нужно 2+ карты.

Полная модель-рассуждение (MoE). Требует кластер из 16+ карт — поможем настроить.

Лидер open-source генерации. 12B параметров, ~12-15 сек на изображение 1024x1024.

3.6 it/s, изображение 1024x1024 за ~6 сек. Огромная экосистема LoRA и ControlNet.

Новейшая SD-модель. Turbo-версия генерирует за ~4 секунды на изображение.

Распознавание речи 99+ языков. 13 мин аудио за ~19 сек — 40x реальное время.

Генерация видео 480p. 5B параметров, ~5-7 мин на клип на RTX 3090.

Синтез речи с клонированием голоса. 2.75x скорость реального времени, MIT-лицензия.

Укажите параметры и запустите сервер за несколько минут

Укажите параметры и запустите сервер за несколько минут

Новейшая HBM3e-память для крупнейших моделей

Флагман для обучения LLM и мультимодальных моделей

80 ГБ HBM2e для обучения крупных моделей

48 ГБ Ada Lovelace для инференса и генерации

24 ГБ для рендеринга и научных вычислений

24 ГБ для инференса и лёгкого обучения

Мы уверены в железе — поэтому даём потестировать до покупки.

Подключитесь по ЭДО, напишите в Telegram, и мы обсудим условия тестового запуска.

Как получить:

Данные для подключения по ЭДО:

Оператор: АО «Калуга Астрал»

ID: 2AEE383BDF8-E70C-4F74-9E7E-995E8AC21999

Мониторинг оборудования 24/7. Серверы работают в российском дата-центре уровня Tier III, а неисправный компонент заменим по гарантии без доплат.

Посекундная тарификация. Выключили сервер — счётчик остановился, данные на диске сохраняются. Скидки до 25% при оплате за 12 месяцев.

Сразу инженер, который разбирается в CUDA, PyTorch и настройке multi-GPU. Поможем с NCCL, distributed training и подбором окружения. Ответ — до 15 минут.