RTX A5000 24GB

GPU для рендеринга и AI

от 32₽/час

Серверы с RTX A5000 24GB

Запуск за 5 минут

Оплата в рублях

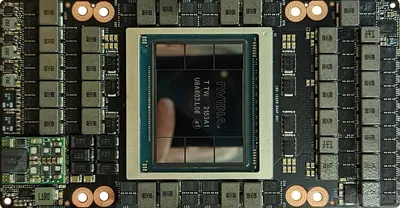

GPU-рендеринг в Blender Cycles, V-Ray и OctaneRender. 64 RT-ядра 2-го поколения ускоряют трассировку лучей, а 24 ГБ памяти вмещают сцены с тяжёлыми текстурами и геометрией.

24 ГБ VRAM достаточно для рендеринга архитектурных сцен и VFX-проектов студийного уровня без выгрузки текстур на CPU.

Запуск и файнтюнинг моделей до 7B параметров в FP16 с запасом VRAM. В квантизации INT4 помещаются модели до 30B — Falcon-40B, LLaMA-2 13B и Stable Diffusion XL.

256 тензорных ядер Ampere ускоряют инференс в FP16/INT8 — A5000 обслуживает несколько запросов к LLM одновременно.

Работа со сложными сборками в SolidWorks и симуляциями в ANSYS. Сертифицированные ISV-драйверы гарантируют стабильную отрисовку моделей до 200 000 компонентов.

ECC-память и TDP всего 230 Вт — A5000 спроектирована для непрерывной работы 24/7 в отличие от игровых карт.

Другая задача? RTX A5000 24GB — профессиональная карта с сертификацией NVIDIA RTX для любых рабочих станций.

24 ГБ GDDR6, профессиональные ISV-драйверы и ECC-память — для рендеринга, AI и САПР.

Вот что помещается на одну карту.

Инференс в FP16. Самая популярная open-source LLM — ~70-80 tok/s на A5000.

Reasoning-модель на базе Qwen. ~45 tok/s на A5000 (Ollama). Продвинутые рассуждения.

Мультиязычная LLM от Alibaba. ~45 tok/s на A5000. Лидер для кода и мультиязычных задач.

Компактная enterprise-модель от Mistral AI. ~37 tok/s на A5000. Function calling, structured output.

Крупнейшая open Gemma от Google. Требует INT4 квантизацию — занимает 80% VRAM. ~29 tok/s.

Даже INT4 требует ~42 ГБ. Необходим кластер из 2+ GPU (48 ГБ через NVLink). FP16 — 140 ГБ.

FP16 занимает 24 ГБ (на пределе), FP8 рекомендован — 16 ГБ. 1024×1024 за ~15-20 сек.

1024×1024 за ~12 сек на A5000. Огромный запас VRAM для LoRA, ControlNet и батчей.

Новейшая SD от Stability AI. 2B параметров MMDiT, улучшенный текст и композиция. 12 ГБ в FP16.

809M параметров. 60 мин аудио за ~17 сек (216× реальное время). 100+ языков.

Генерация видео 480p, 5B параметров. Требует memory optimizations (CPU offload + VAE slicing). ~15 мин/клип.

Синтез речи с клонированием голоса. RTF 0.15 — 7× скорость реального времени. MIT-лицензия.

Укажите параметры и запустите сервер за несколько минут

Укажите параметры и запустите сервер за несколько минут

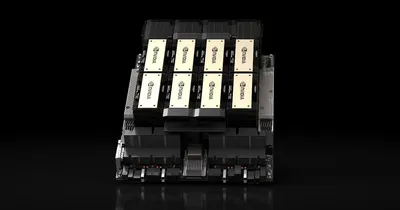

Новейшая HBM3e-память для крупнейших моделей

Флагман для обучения LLM и мультимодальных моделей

80 ГБ HBM2e для обучения крупных моделей

48 ГБ Ada Lovelace для инференса и генерации

24 ГБ. Бюджетный вариант для ML-задач

24 ГБ для инференса и лёгкого обучения

Мы уверены в железе — поэтому даём потестировать до покупки.

Подключитесь по ЭДО, напишите в Telegram, и мы обсудим условия тестового запуска.

Как получить:

Данные для подключения по ЭДО:

Оператор: АО «Калуга Астрал»

ID: 2AEE383BDF8-E70C-4F74-9E7E-995E8AC21999

Мониторинг оборудования 24/7. ECC-память A5000 защищает от ошибок при длительных вычислениях и рендеринге, а неисправный компонент заменим по гарантии без доплат.

Посекундная тарификация. Выключили сервер — счётчик остановился, данные на диске сохраняются. Скидки до 25% при оплате за 12 месяцев.

Сразу инженер, который разбирается в CUDA, PyTorch и профессиональных ISV-приложениях. Поможем с NVLink, рендер-фермами и подбором окружения. Ответ — до 15 минут.