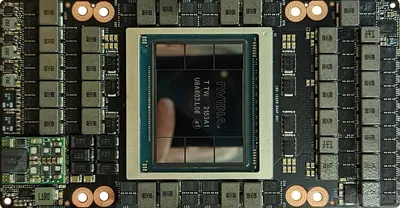

Tesla A10 24GB

инференс и видеообработка

от 29₽/час

Серверы с Tesla A10 24GB

Запуск за 5 минут

Оплата в рублях

Развёртывание языковых моделей для продакшена. 24 ГБ памяти вмещают LLaMA 7B и Mistral 7B целиком в FP16, а модели до 30B — в 4-bit квантизации.

A10 — одна из самых популярных карт для инференса в облаке: Tensor Cores 3-го поколения ускоряют INT8-инференс в 3× по сравнению с T4.

Stable Diffusion XL и FLUX.1 Schnell работают на A10 без ограничений. Эта видеокарта оптимальна для продакшен-сервисов.

A10 обеспечивает до 5× лучшее соотношение цена/производительность на SDXL по сравнению с A100, при сопоставимом качестве.

Аппаратные кодеки NVENC/NVDEC с поддержкой H.264, H.265 и AV1. Tesla A10 не ограничивает число одновременных сессий кодирования.

A10 используется в дата-центрах для транскодирования потокового видео. 150 Вт TDP позволяют разместить несколько карт в одном сервере.

Другая задача? Tesla A10 24GB — оптимальная карта для инференса и медиа-обработки.

24 ГБ GDDR6 и Tensor Cores 3-го поколения — оптимально для инференса и медиа-обработки.

Вот что помещается на одну карту.

Инференс в FP16 без ограничений. Самая популярная open-source LLM — ~30-50 tok/s на A10.

Reasoning-модель на базе Qwen 2.5. FP16 на A10 с запасом, MATH-500: 92.8%.

Мультиязычная LLM от Alibaba. FP16 на A10 — комфортный инференс и поддержка 128K контекста.

12B модель от Mistral + NVIDIA. FP8 без потери качества — 19 ГБ VRAM на A10.

Мощная reasoning-модель. Требует INT4 квантизацию для A10. Превосходит OpenAI o1-mini.

Даже INT4 AWQ требует ~35 ГБ. Необходим кластер из 2+ GPU. FP16 — 140 ГБ.

12B DiT-модель. FP16 занимает ~33 ГБ, но FP8 снижает до 13 ГБ. 1024×1024 за ~10-20 сек на A10.

На A10 с огромным запасом. 1024×1024 за ~10-15 сек. Можно запускать с большими батчами.

Новейшая SD 3.5 Large: 18 ГБ в BF16, помещается на A10. С TensorRT FP8 — всего 11 ГБ.

809M параметров. 13 мин аудио за ~19 сек (faster-whisper, FP16). 100+ языков.

Генерация видео 480p, 5 сек. ~8 ГБ VRAM. На A10 — ~5-7 мин на клип. Открытый код.

Клонирование голоса и синтез речи. Генерация в реальном времени, MIT-лицензия.

Укажите параметры и запустите сервер за несколько минут

Укажите параметры и запустите сервер за несколько минут

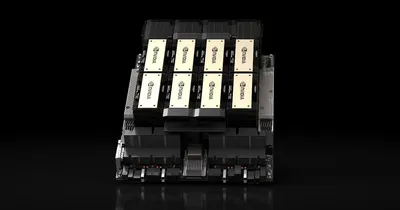

Новейшая HBM3e-память для крупнейших моделей

Флагман для обучения LLM и мультимодальных моделей

80 ГБ HBM2e для обучения крупных моделей

48 ГБ Ada Lovelace для инференса и генерации

24 ГБ. Бюджетный вариант для ML-задач

24 ГБ для рендеринга и научных вычислений

Мы уверены в железе — поэтому даём потестировать до покупки.

Подключитесь по ЭДО, напишите в Telegram, и мы обсудим условия тестового запуска.

Как получить:

Данные для подключения по ЭДО:

Оператор: АО «Калуга Астрал»

ID: 2AEE383BDF8-E70C-4F74-9E7E-995E8AC21999

Мониторинг оборудования 24/7. Серверы работают в российском дата-центре уровня Tier III, а неисправный компонент заменим по гарантии без доплат.

Посекундная тарификация. Выключили сервер — счётчик остановился, данные на диске сохраняются. Скидки до 25% при оплате за 12 месяцев.

Сразу инженер, который разбирается в CUDA, PyTorch и настройке окружения. Поможем с vGPU, NVENC и подбором конфигурации. Ответ — до 15 минут.