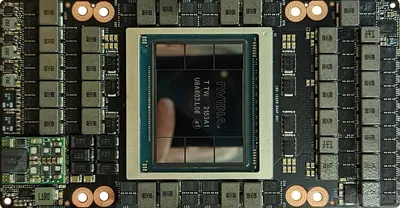

Tesla A100 80GB

обучайте модели

до 70B параметров

от 162₽/час

Серверы с Tesla A100

Запуск за 5 минут

Оплата в рублях

Дообучение и полное обучение нейросетей. 80 ГБ памяти позволяют загрузить модель до 30B параметров целиком в FP16.

Meta обучила LLaMA 2 на кластере из A100 — это стандарт индустрии для обучения LLM.

Через технологию MIG одна A100 делится на 7 независимых GPU, можно обслуживать несколько моделей одновременно.

Тензорные ядра 3-го поколения ускоряют инференс до 20× по сравнению с предыдущим.

Изображения и видео FLUX.2 и Wan 2.2. 80 ГБ памяти позволяют запускать эти модели без квантизации и в полном качестве.

A100 запускает тяжелые модели с лёгкостью. VRAM хватает с запасом.

Другая задача? A100 80GB — универсальная карта, которая справится и с ней.

80 ГБ видеопамяти — достаточно для большинства современных моделей.

Вот что помещается на одну карту.

Fine-tuning и инференс. Самая популярная open-source LLM — ~130 tok/s на A100.

Инференс и дообучение. Продвинутые рассуждения, дистиллирована из DeepSeek-R1 671B.

Инференс в FP16. Конкурирует с моделями 70B при втрое меньшем размере.

Инференс в FP16. Лидер среди 32B-моделей для кода и мультиязычных задач.

Инференс в 4-bit квантизации (AWQ). Эталонная 70B-модель, ~22 tok/s.

Полная модель-рассуждение (MoE). Требует кластер из 16+ карт — поможем настроить.

Лидер open-source генерации. 12B параметров, запас для батчей и LoRA-дообучения.

Новейшая SD-модель. Turbo-версия генерирует за ~2 секунды на изображение.

Проверенная и стабильная. Огромная экосистема LoRA, ControlNet и чекпоинтов.

Генерация видео 720p, 24 fps. A100 80GB — рекомендуемая карта для этой модели.

Распознавание речи 99+ языков. В 6 раз быстрее V3 при минимальной потере точности.

Синтез речи с клонированием голоса. 7× скорость реального времени, MIT-лицензия.

Укажите параметры и запустите сервер за несколько минут

Укажите параметры и запустите сервер за несколько минут

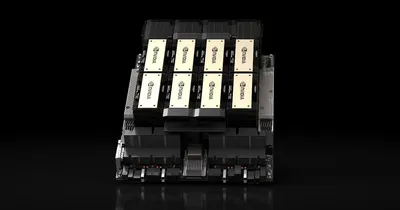

Новейшая HBM3e-память для крупнейших моделей

Флагман для обучения LLM и мультимодальных моделей

48 ГБ Ada Lovelace для инференса и генерации

24 ГБ. Бюджетный вариант для ML-задач

24 ГБ для рендеринга и научных вычислений

24 ГБ для инференса и лёгкого обучения

Мы уверены в железе — поэтому даём потестировать до покупки.

Подключитесь по ЭДО, напишите в Telegram, и мы обсудим условия тестового запуска.

Как получить:

Данные для подключения по ЭДО:

Оператор: АО «Калуга Астрал»

ID: 2AEE383BDF8-E70C-4F74-9E7E-995E8AC21999

Мониторинг оборудования 24/7. ECC-память A100 защищает от ошибок при длительном обучении, а неисправный компонент заменим по гарантии без доплат.

Посекундная тарификация. Выключили сервер — счётчик остановился, данные на диске сохраняются. Скидки до 25% при оплате за 12 месяцев.

Сразу инженер, который разбирается в CUDA, PyTorch и настройке multi-GPU. Поможем с MIG, NCCL и подбором окружения. Ответ — до 15 минут.